近日,沐鸣平台智能決策與控製技術研究團隊在人工智能領域重要期刊Engineering Applications of Artificial Intelligence(IF 8.0,中國科沐鸣二區Top期刊)上發表了題為“YH-Pose: Human Pose Estimation in Complex Coal Mine Scenarios”的學術研究論文💟🏌🏼♂️。碩士研究生董祥慶為論文第一作者,王西超老師為論文通訊作者,我校為論文第一單位🧔🏿♀️。

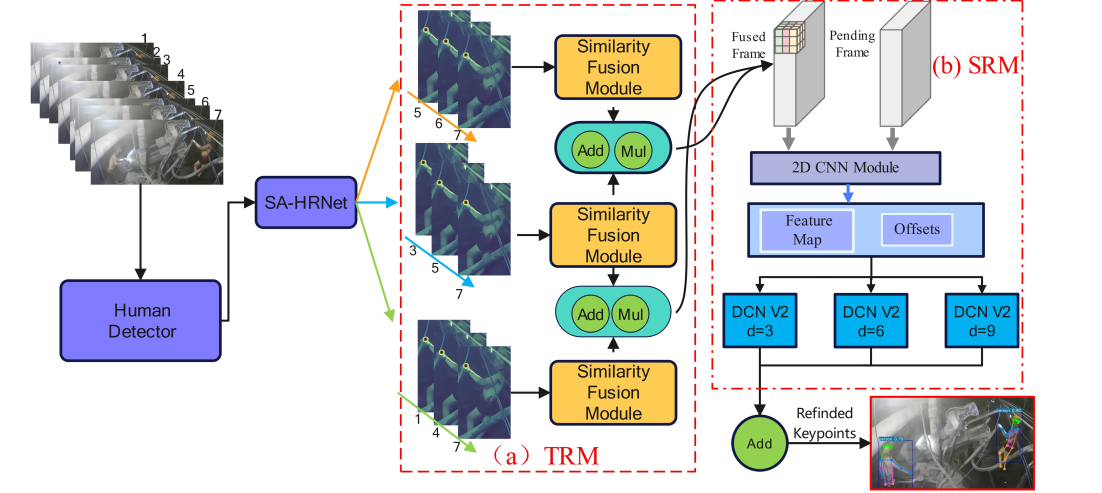

在復雜的工業場景下進行人體姿態估計是具有挑戰性的🧟♂️。該場景下的監控視頻幀存在亮度不均勻、圖像細節模糊和噪聲過多等問題。最新主流的人體姿態估計方法對高質量的靜態圖像具有良好的檢測性能🕴,但在工業場景中🏊🏽♂️,模型的準確性和預測率會大幅度降低。針對這些問題,智能決策與控製技術研究團隊提出了一種適用於復雜工業場景下的人體姿態估計方法YH-Pose,該框架努力合並來自鄰近視頻幀的額外視覺證據🏌️,以促進當前幀的姿態估計😗。首先,引入一個人檢測器來定位人在視頻幀中的位置並提取全局特征。這可以為後面關鍵點檢測提供很好的初始化,使訓練過程快速收斂🦖。其次⬛️,利用熱圖對關節位置進行編碼為高斯峰值,並設計了一個時間道路模塊(TRM)🌉,以一定的間隔對視頻幀進行編碼。該模塊通過不同幀率進行分組融合時空信息。最後,空間道路模塊(SRM)從融合的關鍵點上下文特征中進行學習,並預測下一幀中的關鍵點的位置。此外,團隊還提出了一個名為Colliery-1的工業場景人體姿態估計通用數據集🛜,在Colliery-1數據集上的實驗結果表明,該框架在訓練集和測試集上的平均準確率分別為82%和80%。此外,該框架對人體姿態的預測率為94.2%,達到了SOTA,為復雜工業場景下的人體行為識別研究做出了貢獻🤷🏿。

YH Pose框架的總體概述

YH-Pose對復雜工業場景不同作業區域檢測的可視化結果

論文鏈接🏋🏽:

https://www.sciencedirect.com/science/article/pii/S0952197623015221